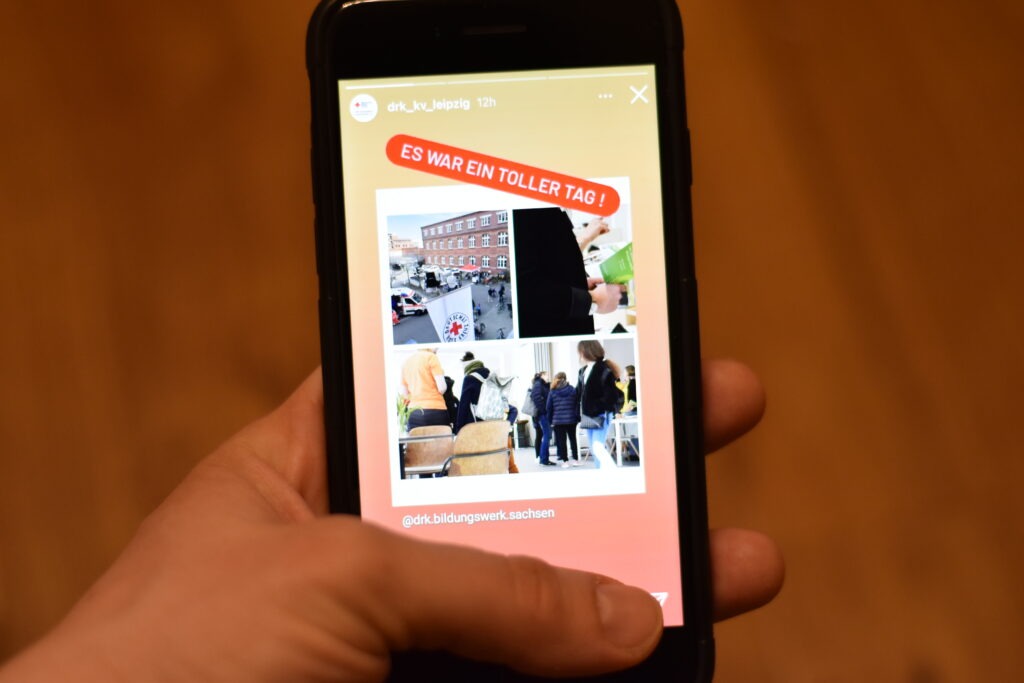

Foto: Said Haider / yana

Wichtiger Hinweis: Der hier vorgestellte Chatbot gegen Diskriminierung hat seit Dezember 2024 einen neuen Namen und heißt jetzt YOUNA. Hier geht’s zum Bot.

Beratungsstellen im gesamten Bundesgebiet melden im Bereich Rechtsextremismus und Rassismus Rekordwerte. Auch die Beratungsanfragen an die Antidiskriminierungsstelle des Bundes haben 2023 ein Rekordhoch erreicht. Said Haider, 39, beobachtet diesen alarmierenden Trend seit Jahren. „In Deutschland haben wir kein flächendeckendes Beratungsnetzwerk. Und die Beratungsstellen, die es gibt, sind oft überlastet und unterfinanziert“, sagt er. Es gebe zu wenig Menschen, die sich um die Probleme der Betroffenen kümmern. Der Volljurist suchte nach einer Lösung und fand sie in Künstlicher Intelligenz. Seine Idee: Ein Bot, der Betroffene nicht mehr alleine lässt. Seine Lösung: yana, „you are not alone“

„Ich wollte Grenzen sprengen“

Fünf Jahre ist das her. „Es gab damals für Menschen, die rassistisch diskriminiert wurden, keine Unterstützung, die den Zeitgeist widerspiegelte.“ Eine technische Lösung sei naheliegend gewesen, weil sie einen Zugang für alle biete. „Ich wollte etwas erschaffen, was die bisherigen Grenzen sprengt“, so der Gründer. Chatbots zur mentalen Gesundheit habe es damals schon gegeben, aber keinen für Diskriminierungsthemen und Rassismus. Zwei Jahre tüftelte er an seiner Idee herum. 2021 launchte er yana. Der Bot beantwortet rechtliche Fragen, gibt emotionalen Support und hilft bei der Therapie-Suche.

Die erste Version des Chatbots ist durch ehrenamtliches Engagement vieler entstanden. „Ich hatte Unterstützer:innen im Team, die eigene Rassismus-Erfahrung mitgebracht haben und mit ihrem technischen Wissen den Bot zum Leben erwecken wollten“, sagt Said. Chatbot-Expert:innen, Designer:innen, Antidiskriminierungsexpert:innen und Psycholog:innen haben den Bot in den vergangenen Jahren immer weiter entwickelt. „Alle vier Elemente waren wichtig. Wir wollten beispielsweise nicht, dass yana aussieht wie ein Behördenbot, auch das Design sollte ansprechend sein.“ Die Psycholog:innen haben sichergestellt, dass sich das Gespräch mit yana für die Betroffenen auch gut anfühlt. „Die Menschen wollen nicht nur rechtliche Informationen oder Handlungstipps, sondern sie kommen oft in emotionalen Situationen zu uns, weil sie entweder hinter einer Krise oder vor einer Krise stehen.“ Das richtig aufzufangen, sei eine große Aufgabe.

Said Haider findet, dass Menschen, die von rassistischen Anfeindungen betroffen sind, zu wenig Unterstützung bekommen. Das will er ändern und zwar mit Hilfe von Künstlicher Intelligenz: Er hat den Antidiskriminierungs-Chatbot yana ins Leben gerufen. Der Bot ist eine erste Anlaufstelle für Betroffene. yana kann ihnen helfen, ihre Erfahrung mit rassistischer Diskriminierung zu verarbeiten und einen persönlichen Umgang damit zu finden.

„Verstanden werden, ist ein Game Changer“

yana kann das. „Sie macht den Raum auf, um das Erlebte nachzuerzählen und zu verarbeiten. Und sie gibt Betroffenen Klarheit, Orientierung und Handlungsempfehlungen“, sagt Said. Der Chatbot spielt die Rolle der zuhörenden Person, gibt praktische Hinweise, ist empathisch und stellt Nachfragen. „yana gibt den Menschen das Gefühl, gehört und verstanden zu werden.“ Das sei wichtig und geradezu ein Game Changer, so der Gründer. Der Bot empowert Betroffene, zeigt ihnen, welche Handlungsoptionen sie haben und wägt gemeinsam mit ihnen das Für und Wider ab.

Eine weitere große Stärke des Bots: yana ist anonym. „Wir haben herausgefunden, dass sich einige Betroffene Maschinen gegenüber leichter öffnen können als einem Menschen“, sagt Said. „Oft haben Betroffene Angst erkannt zu werden oder wollen nicht das Risiko eingehen, dass die vertraulichen Informationen irgendwann gegen sie verwendet werden.“ Daher schweigen viele. „Sie gehen nicht zu Beratungsstellen, sondern schlucken das Ganze.“ Doch Schweigen helfe nicht. Im Gegenteil, es lässt Situationen schnell ausweglos erscheinen, die Menschen bleiben hilflos zurück.

„Der Bot kann Menschen nicht ersetzen“

yana will diese Lücke füllen. Doch auch das Hilfs- und Beratungsangebot des Bots hat Grenzen. yana gebe eine erste Orientierung, sei aber nicht die letzte Option für Ratsuchende. Auch für schwere Krisensituationen, beispielsweise für suizidgefährdete Menschen, ist der Bot nicht ausgerichtet. „yana weiß, wie man damit umgeht, aber sie ist nicht dafür gedacht.“ In diesen Fällen verweist yana die User auf Hilfsangebote in der realen Welt. Der Bot kann keine Menschen ersetzen, das betont der Gründer immer wieder. „Das soll er auch gar nicht. Aber er will die bestehenden Beratungsstrukturen entlasten.“

Momentan hat yana rund 100 bis 150 User:innen im Monat, wenn Werbung für ein yana-Update auf den eigenen Instagram- oder LinkedIn-Kanälen läuft, auch schon mal 3.000. Das Feedback der Community ist für das yana-Team „fundamental“, so nennt es der Gründer. „Nur so können wir yana verbessern.“ Im vergangenen Jahr wurde der Bot vom Bundesministerium für Wirtschaft und Klimaschutz gefördert. Aktuelle Förderpartner sind die Robert-Bosch-Stiftung und die Crespo-Foundation. Damit ist die Finanzierung des sozialen Tech-Start-ups für die kommenden drei Jahre gesichert.

„Ready für die Landtagswahlen“

Momentan arbeitet das Team an einem neuen Update. Bis zu den Landtagswahlen in Thüringen, Brandenburg und Sachsen im September soll es fertig sein. Damit will sich das yana-Team für den „Worst-Case“ wappnen. „Wir befürchten, dass rechte Parteien extremen Zulauf haben werden, vielleicht sogar in die Regierungsbeteiligung kommen.“ Für von Rassismus betroffene Menschen sei das eine extreme Situation, die Ängste schürt und Unsicherheit anwachsen lasse. „Wir wollen ready sein und den Menschen mit yana Raum für Gespräche bieten.“

Die Vision des Gründers: yana nicht nur als Chatbot, sondern ähnlich wie Siri oder Alexa, als Sprachbot nutzbar machen – ohne Textbarriere. „Und im Idealfall sogar auf unterschiedlichen Sprachen.“ Said will zunächst den deutschsprachigen Raum abdecken und dann weiterskalieren bis hin zu einer internationalen Organisation. „Wir träumen davon, dass yana irgendwann Geschwister bekommt: Chatbots für Sexismus, Ableismus und andere Gebiete“, sagt Said. Dafür müssten mehr Organisationen in diesen Feldern KI sinnvoll einsetzen. „Es wäre toll, wenn sie ihre Expertise und Ökosysteme nutzen, um in der digitalen Welt Angebote zu schaffen.“ Künstliche Intelligenz nicht zu nutzen, wäre eine vertane Chance, findet Said, sich nur auf sie zu verlassen aber ebenfalls ein Fehler. „Digitale Empathie kann nie menschliche Empathie ersetzen, digitale Beratung nie einen Menschen, der direkt mit einem spricht.“ Aber KI könne einspringen, wenn sonst niemand da ist.

Dieses Werk ist lizenziert unter einer Creative Commons Namensnennung-Nicht kommerziell 4.0 International Lizenz.